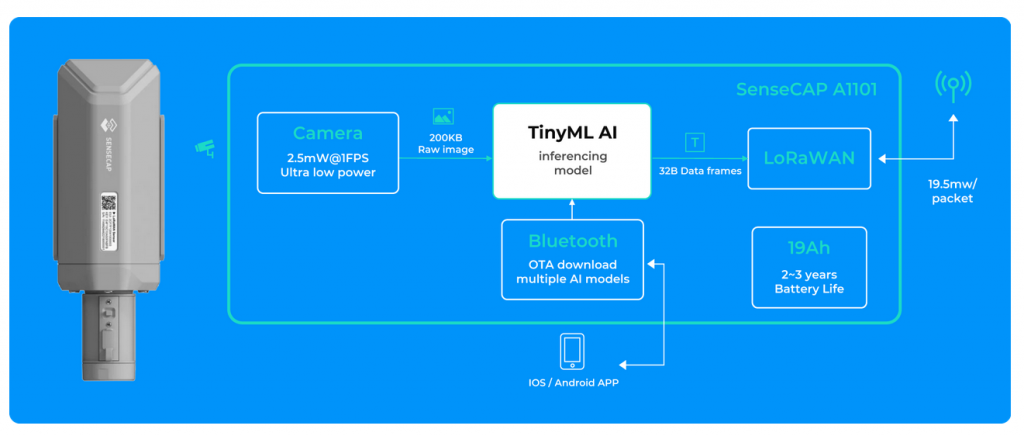

SenseCAP A1101 è un sensore di immagine intelligente abilitato al TinyML ed Edge AI. SenseCAP A1101 combina la tecnologia TinyML e la trasmissione a lungo raggio LoRaWAN per realizzare un dispositivo per l'Intelligenza Artificiale a bassa potenza e ad alte prestazioni sia per uso interno che esterno. SenseCAP A1101 supporta una varietà di modelli di Intelligenza Artificiale come riconoscimento delle immagini, conteggio delle persone, rilevamento del target, ecc. In questo articolo andremo a descrivere le caratteristiche principali del sensore e vedremo come addestrare e distribuire un modello di Intelligenza Artificiale sullo stesso.

Introduzione

SenseCAP A1101 è un sensore per il riconoscimento delle immagini progettato per gli sviluppatori. Questo sensore risulta una scelta ottimale per chi voglia sviluppare applicazioni Edge AI e di riconoscimento dell'immagine e stia cercando una piattaforma hardware affidabile e a basso costo per iniziare. SenseCAP A1101 combina la tecnologia TinyML e la trasmissione a lungo raggio LoRaWAN in un unico dispositivo (Figura 1) in grado di implementare un'ampia varietà di applicazioni di Intelligenza Artificiale. Questo sensore è dotato della soluzione di visione artificiale ad alte prestazioni e bassa potenza di Himax che supporta il framework TensorFlow Lite di Google e diverse piattaforme di Intelligenza Artificiale TinyML. Diversi modelli possono implementare diverse funzioni di Intelligenza Artificiale, ad esempio rilevamento dei parassiti, conteggio delle persone, riconoscimento di oggetti. Gli utenti possono adottare i modelli forniti da Seeed, generare i propri modelli attraverso strumenti di addestramento o procurarsi modelli commerciali implementabili dai partner di Seeed.

Figura 1: SenseCAP A1101 combina la tecnologia TinyML e la trasmissione a lungo raggio LoRaWAN

Caratteristiche

La linea di prodotti SenseCAP, di Seeed Studio, comprende diversi hardware e servizi software. SenseCAP è stata specificamente progettata per soddisfare le esigenze di rilevamento wireless dell'IoT industriale, con le principali applicazioni nell'agricoltura intelligente, nelle città intelligenti e in altri scenari di rilevamento ambientale.

Attualmente, la linea SenseCAP è composta da:

- gateway e sensori della serie SenseCAP LoRaWAN

- Sensor Hub 2G/4G Data Logger

- sensori RS-485 e sensori meteorologici

Oltre all'hardware, vengono forniti anche servizi software e cloud tra cui SenseCAP API, SenseCAP APP, SenseCAP Portal e SenseCAP Dashboard per gestire facilmente i dispositivi e i dati. La serie SenseCAP LoRaWAN, di cui fa parte SenseCAP A1101, comprende sensori e gateway che supportano il protocollo LoRaWAN e sono certificati LoRaWAN. Questi prodotti sono adatti per applicazioni che richiedono la trasmissione wireless di dati su una distanza ultra ampia: 9,6 km in linea di vista e 2 km in aree urbane, secondo i test. Inoltre, le funzionalità a basso consumo energetico supportano una durata media della batteria di 3 anni, alcuni nodi sensori possono durare più di 8 anni a seconda del consumo energetico.

Le caratteristiche più rilevanti del sensore SenseCAP A1101 sono:

- una potente camera Himax a bassissima potenza: DSP a 400 MHz, frame rate massimo 60 FPS con risoluzione della fotocamera 640 * 480 * VGA , inferenza locale;

- bassa potenza e trasmissione a lungo raggio: consumo energetico fino a 2,3 uWh in modalità sospensione, alimentato dai moduli Wio-E5 LoRaWAN, trasferisce dati nel raggio di miglia;

- elevata sicurezza dei dati tramite Edge Computing: inferenza locale delle immagini e trasferimento del risultato finale al cloud, adatto per applicazioni che richiedono una trasmissione dati limitata e un'elevata privacy dei dati;

- facile visualizzazione dei dati: pochi clic per visualizzare e gestire i dati tramite SenseCAP Mate App e SenseCAP Dashboard, ampia compatibilità con altri strumenti di terze parti;

- elevato grado di protezione industriale: temperatura di esercizio -40 ~ 85 ℃ e grado di protezione IP66, adatto per installazioni interne ed esterne;

- facilità per una distribuzione scalabile: 1 minuto per aggiungere e configurare il dispositivo scansionando il codice QR dello stesso, i bassi costi di rete LoRaWAN e i costi di manutenzione garantiscono la scalabilità in termini economici.

Inoltre, grazie ai servizi software forniti gratuitamente, come SenseCAP Mate App e SenseCAP Cloud, è molto semplice ottenere e utilizzare i dati con pochi clic. Attraverso semplici passaggi si possono collegare i sensori tramite il SenseCAP Cloud e trasferire i dati tramite LoRa in 10 minuti.

SenseCAP A1101 è un prodotto che necessita dello sviluppo secondario da parte degli sviluppatori per essere distribuito in un'applicazione reale e consente agli utenti di:

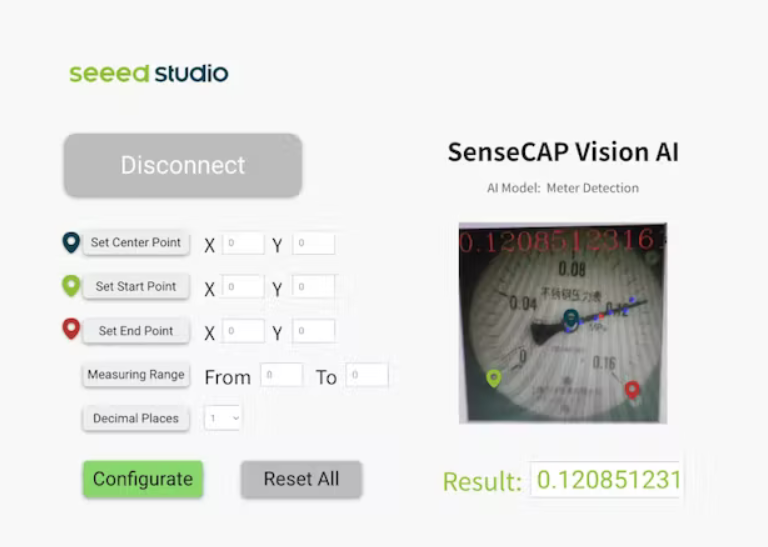

- testare SenseCAP A1101 con i due modelli demo forniti con il prodotto (rilevamento persone e riconoscimento contatore riportato in Figura 2) e sperimentare le applicazioni di Vision AI;

- raccogliere immagini utilizzando SenseCAP A1101 e generare un dataset attraverso una piattaforma di annotazione (es.: RoboFlow);

- addestrare e generare i propri modelli attraverso strumenti di addestramento di terze parti e distribuirli su SenseCAP A1101;

- collaborare con un partner nel settore dell'IA per generare set di dati, addestrare modelli, sviluppare algoritmi, ecc. ed ottenere così dei modelli personalizzati e implementabili per applicazioni specifiche e distribuirli in SenseCAP A1101.

Figura 2: Modello demo fornito con il prodotto per il riconoscimento della lettura di un contatore

Esempio di applicazione

Vediamo adesso come addestrare un modello di Intelligenza Artificiale per la propria applicazione specifica e quindi distribuirlo facilmente su SenseCAP A1101. Per realizzare l'applicazione vengono utilizzati alcuni software, descritti brevemente di seguito.

Roboflow è uno strumento di annotazione online. Questo strumento consente di etichettare facilmente tutte le immagini, aggiungere ulteriore elaborazione a queste immagini ed esportare il set di dati etichettato in diversi formati come YOLOV5 PyTorch, Pascal VOC e altro. Roboflow ha anche set di dati pubblici prontamente disponibili per gli utenti.

YOLO è l'abbreviazione del termine "You Only Look Once", ed è un algoritmo che rileva e riconosce vari oggetti in un'immagine in tempo reale. Ultralytics YOLOv5 è la versione di YOLO basata sul framework PyTorch.

YOLO è uno degli algoritmi di rilevamento di oggetti più famosi grazie alla sua velocità e precisione. Il rilevamento di oggetti si riferisce al rilevamento e alla localizzazione di oggetti, in un'immagine, che appartengono a un insieme predefinito di classi. Il rilevamento di oggetti a due fasi si riferisce all'uso di algoritmi che scompongono il problema del rilevamento di oggetti nelle seguenti due fasi:

- Rilevamento di possibili regioni dell'oggetto (Bounding Box)

- Classificazione dell'immagine in quelle regioni in classi di oggetti

Sebbene ciò fornisca risultati accurati nel rilevamento di oggetti, presenta come inconveniente l'esecuzione di multiple iterazioni che si verificano nella stessa immagine, rallentando così la velocità di rilevamento dell'algoritmo e impedendo il rilevamento in tempo reale. YOLO, invece, propone l'uso di una rete neurale per eseguire le previsioni sulle bounding box e sulla probabilità di classe contemporaneamente. Per prima cosa, l'immagine viene suddivisa in una griglia da SxS celle. Se il centro di un oggetto ricade in una cella della griglia, allora quella cella è responsabile del rilevamento dell'oggetto. Ogni cella della griglia prevede B bounding box e B punteggi di confidenza per le bounding box. Questi punteggi di confidenza riflettono la sicurezza del modello che la bounding box contenga un oggetto. Ogni cella della griglia prevede anche le probabilità condizionate di classe. Queste probabilità sono condizionate alla cella della griglia contenente un oggetto. Quindi, vengono moltiplicate le probabilità condizionate della classe e le previsioni di confidenza delle singole bounding box, ottenendo così punteggi di confidenza specifici della classe per ciascuna bounding box. Questi punteggi codificano sia la probabilità che quella classe appaia nella bounding box sia quanto bene la bounding box si adatti all'oggetto. La Figura 3 illustra quanto appena descritto.

ATTENZIONE: quello che hai appena letto è solo un estratto, l'Articolo Tecnico completo è composto da ben 2036 parole ed è riservato agli ABBONATI. Con l'Abbonamento avrai anche accesso a tutti gli altri Articoli Tecnici che potrai leggere in formato PDF per un anno. ABBONATI ORA, è semplice e sicuro.