È un grande sogno, la chimera dei nostri tempi. Dai sensori all’intelligenza artificiale (AI), la classica supply chain dell’elettronica ha formato una matrice collaborativa, dedicata alla sicurezza dei veicoli a guida autonoma. A tale scopo, nello sviluppo di hardware e software c’è ancora molto da fare per poter garantire che guidatori, passeggeri e pedoni siano protetti. Anche se machine learning e AI hanno il proprio ruolo da svolgere, la loro efficacia dipende dalla qualità dei dati d’ingresso. In quanto tale, nessun veicolo a guida autonoma può essere considerato sicuro a meno che non sia realizzato sulle basi di una catena del segnale con sensori ad alte prestazioni, alta integrità, che fornisca consistentemente dati il più possibile accurati sui quali basare decisioni vitali.

Introduzione

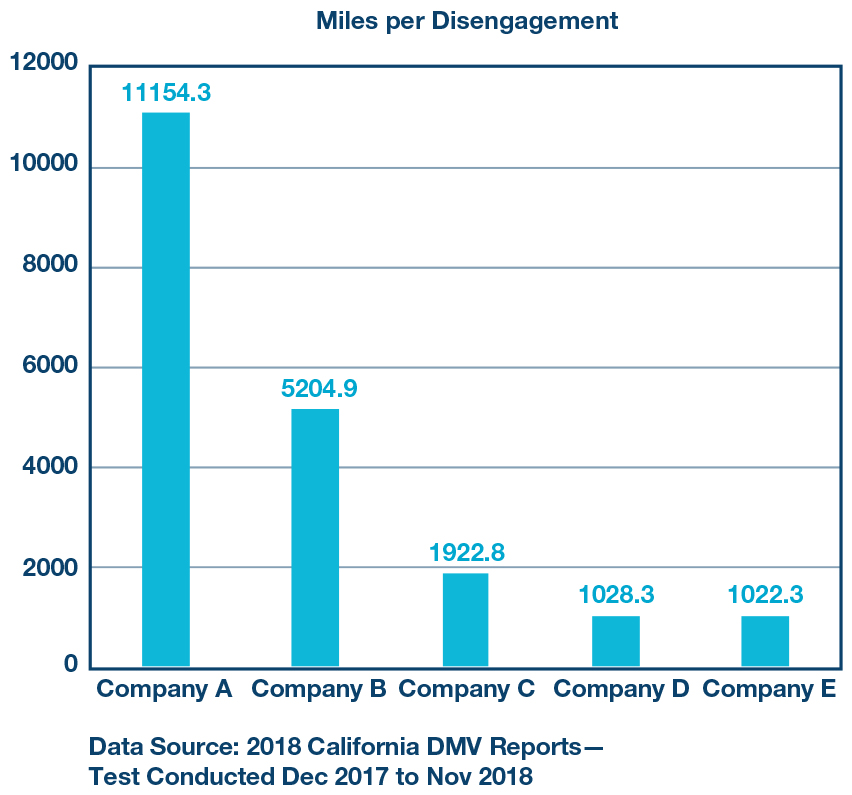

Come accade per tutti i grandi sogni, il percorso verso la sicurezza dei veicoli a guida autonoma è ancora irto di ostacoli. I recenti, eclatanti incidenti che hanno coinvolto vetture a guida autonoma fomentano le interpretazioni dei pessimisti, secondo i quali i veicoli e gli ambienti in cui si muovono sono eccessivamente complessi, esistono troppe variabili e gli algoritmi e il software sono ancora pieni di bachi. Chiunque conosca i test di conformità allo standard ISO 26262, sulla Sicurezza Funzionale del Veicolo, sa che i pessimisti dovrebbero essere perdonati per il loro scetticismo. E lo scetticismo è supportato dai grafici che mettono in relazione le miglia percorse con il numero dei disinserimenti dalla modalità automatica (Figura 1), relativi a test eseguiti nella Silicon Valley nel 2017 da cinque aziende produttrici di veicoli a guida autonoma. I numeri per il 2019 devono ancora essere elaborati, ma i rapporti per le singole società sono disponibili online.

Tuttavia, l’obiettivo è stato definito e l’imperativo è chiaro: l’autonomia del veicolo è in arrivo e la sicurezza risulta un fattore fondamentale. Di certo, i dati non ufficiali del California Autonomous Vehicle DMV, relativi al 2018, indicano che il numero dei disinserimenti per miglio è in diminuzione, dimostrando che i sistemi stanno diventando più efficaci.

Mettendo al primo posto collaborazione e nuove forme di pensiero, i produttori del settore automotive stanno dialogando direttamente con i venditori di silicio; le aziende che producono sensori stanno parlando di sensor fusion con gli sviluppatori di algoritmi di AI; e, finalmente, gli sviluppatori di software si stanno mettendo in contatto con i fornitori di hardware, per trarre il meglio da entrambe le parti. Le vecchie relazioni stanno cambiando, sostituite dai nuovi rapporti che si formano dinamicamente, per ottimizzare la combinazione di prestazioni, funzionalità, affidabilità, costo e sicurezza nella progettazione finale.

Figura 1: Le miglia percorse in California dai primi 5 produttori di veicoli autonomi (da dicembre 2017 a novembre 2018). In totale, 28 aziende hanno testato attivamente i veicoli in pubblico durante questo periodo in California, per un totale di 2.036.296 miglia percorse in modo autonomo e 143.720 disinserimenti.

Da un capo all’altro, l’ecosistema sta perseguendo i modelli corretti sui quali costruire e collaudare veicoli a guida completamente autonoma, per applicazioni che stanno emergendo velocemente, come nel caso dei robo-taxi e degli autotrasporti a lungo raggio. Lungo il percorso, si sta rapidamente ottenendo un sempre più elevato livello di automazione, come risultato del miglioramento dei sensori, che sollecita lo stato dell’arte dei sistemi a guida assistita avanzati (ADAS).

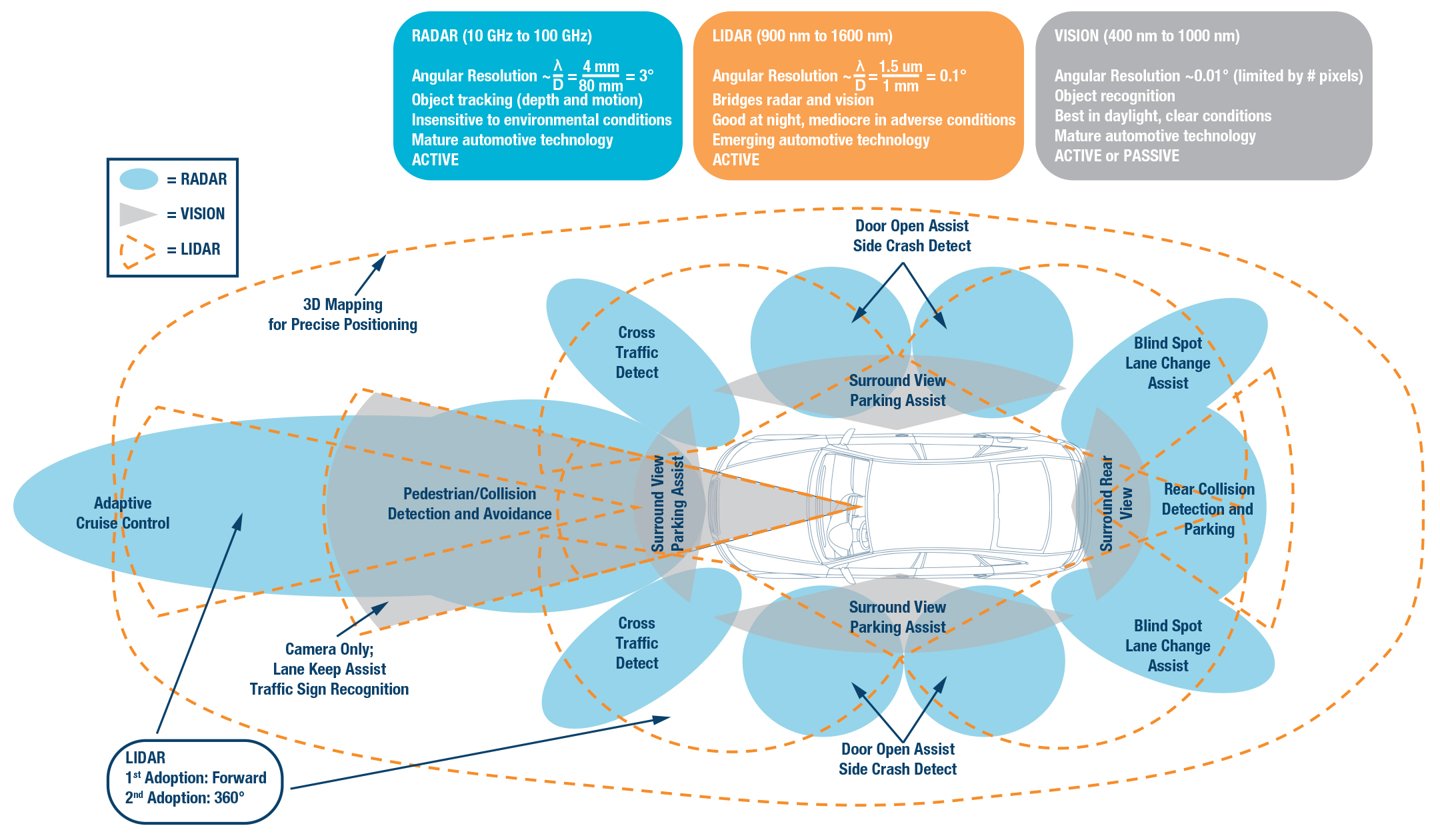

Queste tecnologie per sensori includono telecamere, sistemi lidar (light-detection-and-ranging), radar (radio detection and ranging), sistemi microelettromeccanici (MEMS) unità di rilevamento inerziale (IMU) ultrasuoni e GPS; tutti forniscono dati di ingresso critici per i sistemi AI, che guideranno il veicolo autonomo con capacità realmente cognitive.

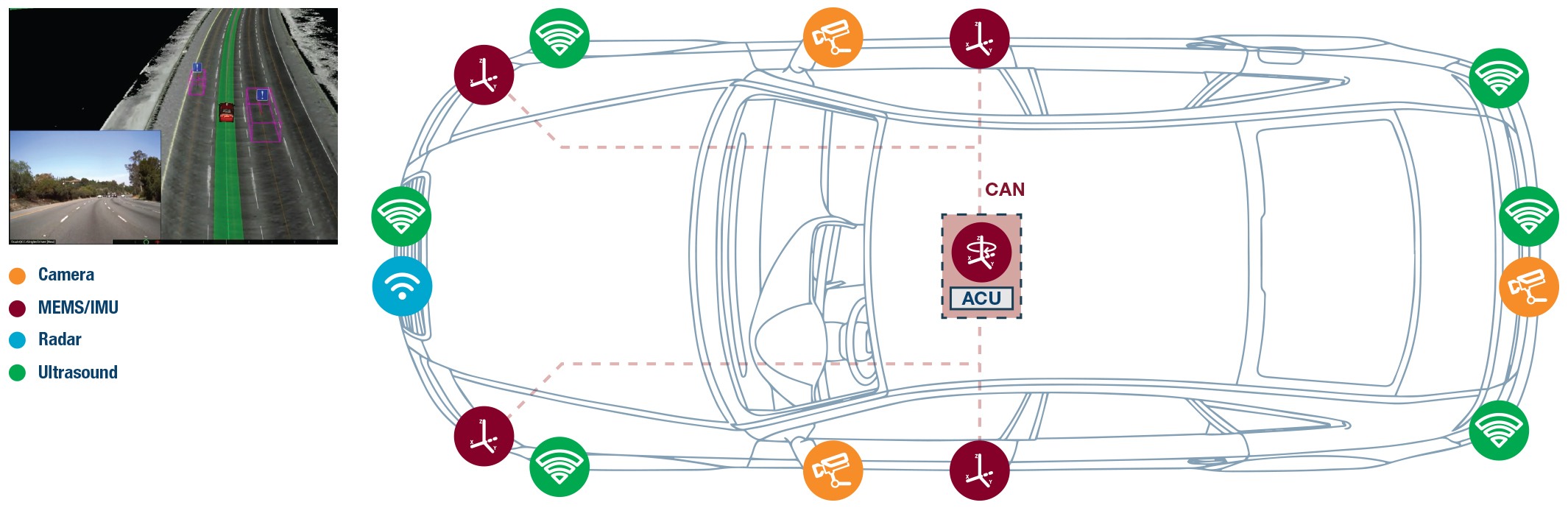

Figura 2: In un sistema ADAS, vi sono diverse modalità di sensing, che vengono utilizzate per la percezione e la navigazione dei veicoli; tendono a lavorare in modo indipendente e forniscono semplicemente degli avvisi ai guidatori, permettendo di reagire di conseguenza.

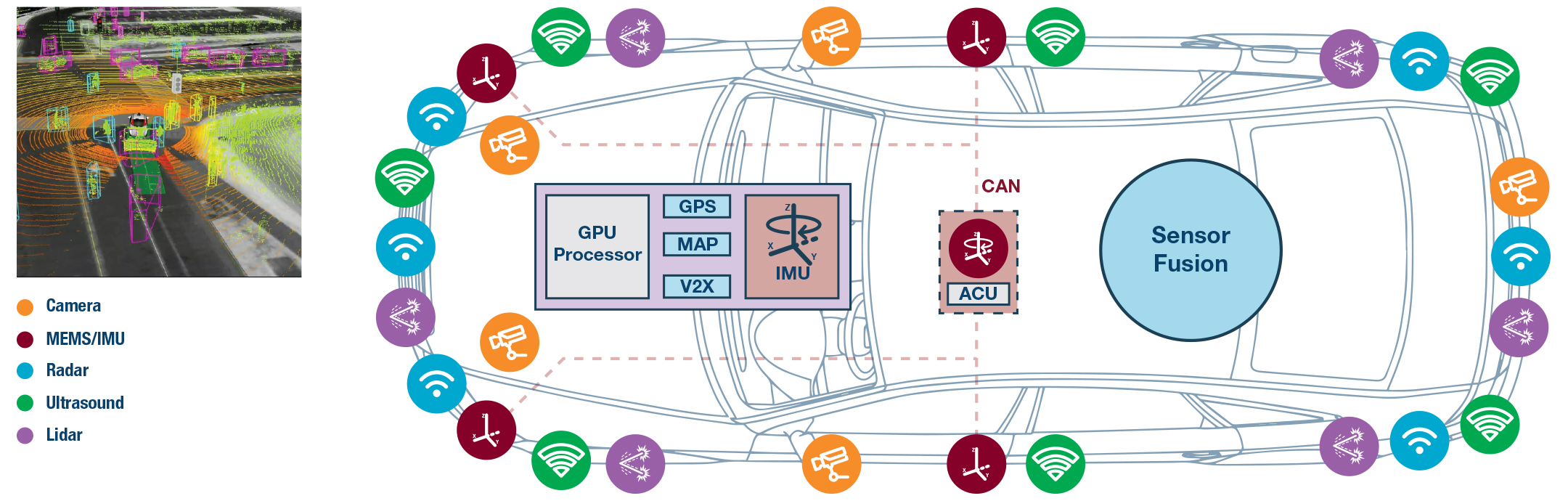

Figura 3: Un veicolo completamente cognitivo, che sia consapevole di tutte le informazioni, sia attuali che storiche e sulla natura dell’ambiente circostante così come sul proprio stato (posizione, velocità, traiettoria e condizioni meccaniche), è necessario per la sicurezza del trasporto autonomo.

I veicoli a capacità cognitiva sono un elemento fondamentale per la sicurezza predittiva

L’intelligenza di un veicolo viene comunemente espressa in Livelli di Autonomia. I Livelli 1 e 2 sono perlopiù tipici dei sistemi di avviso, mentre per il Livello 3 e quelli superiori il veicolo può agire in modo autonomo per evitare un incidente. Salendo al livello 5, il volante viene a mancare e la vettura opera in completa autonomia.

Con l’avvicinarsi dei veicoli alla funzionalità di Livello 2, in queste prime, poche generazioni, i sistemi a sensore funzionano in modo indipendente. Questi sistemi di avviso hanno un’alta percentuale di falsi allarmi e, risultando fastidiosi, vengono spesso disattivati.

Per arrivare ai veicoli a guida autonoma completamente cognitivi, il numero di sensori aumenta in modo significativo. Inoltre le loro prestazioni e i tempi di risposta devono essere fortemente migliorati (Figura 3, Figura 4).

Integrando nei veicoli un maggior numero di sensori, è possibile anche monitorare e catalogare meglio le condizioni meccaniche correnti, come pressione degli pneumatici o variazioni di peso (ad es. a pieno carico o a vuoto, uno o sei passeggeri), così come i fattori d’usura che possono condizionare la frenata e la gestione del veicolo. Aumentando le modalità di sensing esterno, il veicolo può diventare maggiormente cognitivo, rispetto al proprio stato di salute e all’ambiente che lo circonda.

Citando i principi sviluppati dal Dr. Joseph Mitola, Chief Technologist, ENSCO Aerospace Sciences and Engineering Division, i progressi conseguiti nelle modalità di sensing permettono al veicolo non solo di riconoscere lo stato attuale dell’ambiente ma anche di essere informato sul suo passato. Ciò può consistere semplicemente nella conoscenza delle condizioni della strada, come la dislocazione delle buche o, più in dettaglio, del tipo di incidenti verificatisi nel tempo in una certa area e dei motivi che li hanno provocati.

All’epoca dello sviluppo di questi concetti cognitivi, il (modesto) livello di sensing, elaborazione, capacità di memoria e connettività li faceva apparire inverosimili. Oggi è possibile accedere ai dati storici catalogati e combinarli con quelli che provengono, in tempo reale, dai sensori del veicolo, per fornire azioni preventive di livello sempre più accurato, ed evitare incidenti.

Per esempio, una IMU può rilevare un sobbalzo o una sterzata improvvisi, che indicano una buca o un ostacolo. Precedentemente queste informazioni non venivano raccolte ma oggi la connettività in tempo reale permette che i dati vengano immediatamente inviati a un database centralizzato e utilizzati per avvisare altri veicoli della presenza della buca o dell’ostacolo.

Lo stesso vale per telecamere, radar, lidar e altri dati forniti dai sensori.

Questi dati vengono raccolti, analizzati e incrociati in modo che possano informare il veicolo circa l’ambiente in cui opera. Ciò permette al veicolo di agire come una macchina in grado di imparare che potenzialmente potrà prendere decisioni migliori e più sicure di quelle di un essere umano.

Processo decisionale e analitico multiforme

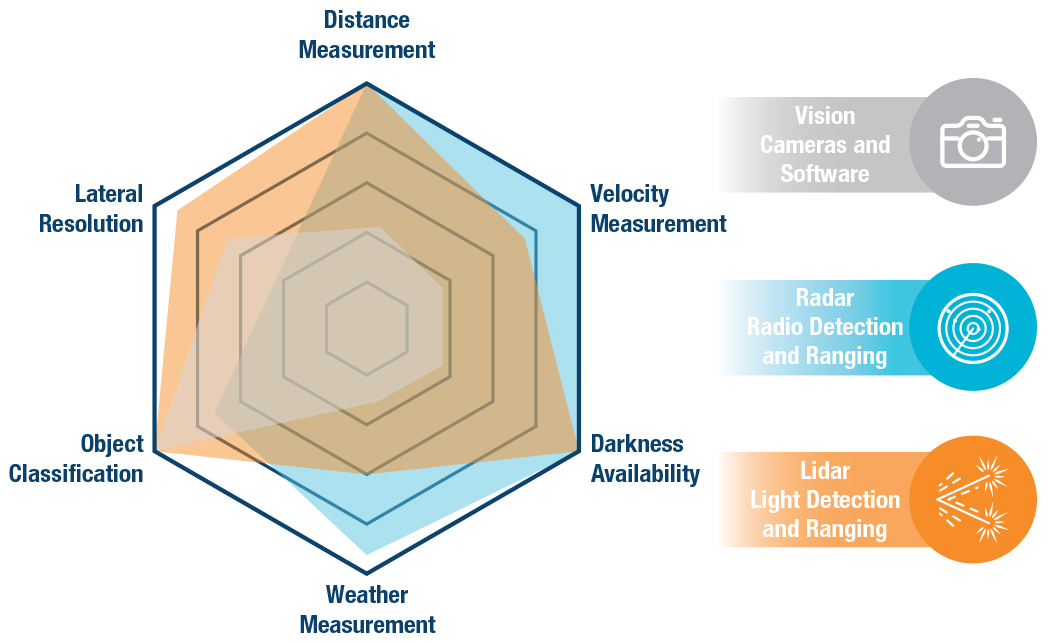

Sono stati fatti molti progressi per migliorare lo stato dell’arte della percezione dei veicoli. L’enfasi viene posta sulla raccolta dati dai vari sensori e sull’applicazione delle strategie di sensor fusion, per massimizzarne i punti di forza complementari e dare supporto alle rispettive debolezze, in diverse condizioni (Figura 5).

Figura 5: Ogni modalità di sensing ha i propri punti di forza e di debolezza ma, con le opportune strategie di sensor fusion, è possibile rendere complementari i punti di forza e dare supporto a quelli più deboli.

Considerando i problemi che l’industria sta affrontando, per farle diventare soluzioni realmente percorribili resta ancora parecchio da fare. Per esempio, le telecamere possono permettere il calcolo della velocità laterale (cioè la velocità di un oggetto che viaggia ortogonalmente rispetto al senso di marcia del veicolo), in ogni caso, anche il migliore tra gli algoritmi di machine learning richiede circa 300 ms per rilevare un movimento laterale con un numero di falsi allarmi sufficientemente basso. Per un pedone, che si muove verso un veicolo in marcia a 100 km/h, i millisecondi possono fare la differenza tra ferite superficiali e potenzialmente letali, per cui il tempo di risposta diventa determinante.

Il ritardo di 300 ms è dovuto al tempo richiesto per eseguire i calcoli del vettore delta tramite i fotogrammi video successivi. Per un rilevamento affidabile sono necessari 10 o più fotogrammi in sequenza: per lasciare al veicolo il tempo di rispondere, dobbiamo diminuire la successione ad uno o due fotogrammi. Il radar ha la capacità di raggiungere questo obiettivo.

Similmente, il radar presenta molti vantaggi nel rilevare velocità e oggetti, ad esempio l’alta risoluzione, sia in azimuth sia in elevazione, così come l’abilità di “vedere” attorno agli oggetti ma, a sua volta, deve dare più tempo al veicolo per reagire.

Con l’obiettivo di determinare senza ambiguità velocità superiori a 400 km/h, pare che i nuovi sviluppi, con funzionamento a 77 e 79 GHz, siano sulla buona strada per raggiungere lo scopo. Tale livello di determinazione della velocità può apparire estremo, ma è necessario per supportare i casi d’uso complessi in autostrade a carreggiate separate, dove i veicoli viaggiano in direzioni opposte a velocità anche superiori a 200 km/h.

Il sistema che colma le distanze tra telecamera e radar è il lidar, le cui caratteristiche lo hanno reso un elemento fruibile ed essenziale del veicolo completamente cognitivo (Figura 6). Ma anche in questo caso si tratta di sfide che dovranno essere risolte in futuro.

Di certo, il lidar sta evolvendo in design compatti, economici e a stato solido che possono essere collocati in più punti, attorno al veicolo, per supportare una copertura a 360˚. Il lidar è complementare ai sistemi radar e alla telecamera, e aggiunge una risoluzione angolare e una percezione della profondità più elevate, per fornire una mappa 3D dell’ambiente più accurata.

Tuttavia, operare in area vicina all’infrarosso (IR) (da 850 a 940 nm) può essere pericoloso per la retina, per cui la sua emissione energetica è rigidamente contenuta in 200 nJ, per impulso a 905 nm. Comunque, spostandosi verso gli IR a onda-corta, oltre i 1.500 nm, la luce viene assorbita dall’intera superficie oculare, consentendo il limite meno restrittivo di 8 mJ, per impulso. Con un livello energetico pari a 40.000 volte quello del lidar a 905 nm, i sistemi lidar pulsati a 1.500 nm forniscono un intervallo di rilevamento quattro volte superiore. Inoltre, i sistemi a 1.500 nm possono risultare più robusti, rispetto a certe condizioni ambientali, come nebbia, polvere e particelle acquose in sospensione.

Con il lidar a 1.500 nm, la sfida è rappresentata dal costo di sistema, condizionato in gran parte dalla tecnologia del fotosensore, che attualmente è basata su InGaAs, con wafer da due pollici. Ottimizzare la soluzione ad alta qualità, con sensibilità elevata, bassa capacità e bassa corrente in assenza di luce, rappresenta il principale fattore abilitante per il lidar da 1.500 nm. Inoltre, con l’evoluzione dei sistemi lidar verso la seconda e la terza generazione, sarà necessario integrare il circuito, ottimizzato sull’applicazione, per ridurre dimensioni, potenza e costo complessivo del sistema.

Oltre ad ultrasuoni, telecamere, radar e lidar, esistono altre modalità di sensing che possono svolgere un ruolo critico nell’abilitazione di un mezzo di trasporto autonomo completamente cognitivo. Il GPS permette di conoscere la posizione di un veicolo in ogni momento. Detto questo, ci sono dei luoghi dove il segnale GPS non è disponibile, come nelle gallerie e tra grattacieli. Questi sono casi in cui le unità di rilevamento inerziale (IMU) possono giocare un ruolo importante.

Figura 6: Il veicolo completamente cognitivo sarà abilitato alla visione a 360˚ utilizzando prevalentemente sistemi radar, lidar avanzati e telecamere, oltre a unità di rilevamento inerziale (IMU) e ultrasuoni.

Anche se è un aspetto spesso trascurato, le IMU dipendono dalla gravità, che è costante, indipendentemente dalle condizioni atmosferiche. Come tali, sono molto utili nelle zone d’ombra. In caso di assenza temporanea del segnale GPS, in queste zone vengono utilizzati i dati provenienti da fonti come tachimetro e IMU per ricavare distanza e direzione percorse, sovrapponendo questi dati alle mappe ad alta definizione. Ciò consente di mantenere un veicolo cognitivo sulla traiettoria corretta, finché non viene ripristinato il segnale GPS.

Dati di alta qualità permettono di risparmiare tempo e salvare vite umane

Per quanto queste modalità di sensing possano essere importanti, nessuno dei dati in arrivo da questi sensori critici avrebbe importanza se gli stessi sensori non fossero affidabili e se i rispettivi segnali d’uscita non venissero catturati accuratamente per essere inviati a monte come dati di alta precisione: raramente l’espressione “garbage in, garbage out,” è stata più pertinente.

Per raggiungere questo risultato, anche le più avanzate catene di segnale analogiche devono essere migliorate di continuo per rilevare, acquisire e digitalizzare i segnali in uscita dai sensori, di modo che i loro livelli di accuratezza e precisione non derivino col tempo e con le variazioni di temperatura. Con i componenti corretti e una progettazione eseguita a regola d’arte, gli effetti di problemi notoriamente critici, come deriva in temperatura, rumore di fase, interferenze e altri fenomeni che causano instabilità, possono essere ampiamente attenuati. I dati di alta precisione e alta qualità sono fondamentali per far sì che machine learning e processori AI vengano istruiti in modo appropriato e perché possano prendere le decisioni corrette quando si trovano in funzione, in queste occasione ci sono poche “seconde opportunità”.

Una volta garantita la qualità dei dati, i diversi approcci di sensor fusion e gli algoritmi AI possono reagire in condizioni ottimali verso una reazione positiva. È un dato di fatto, per quanto sia ben addestrato un algoritmo AI, una volta che il modello è compilato e distribuito ai dispositivi della rete, per la loro efficacia dipendono completamente da dati dei sensori affidabili e altamente precisi.

Questa interattività tra modalità del sensore, sensor fusion, elaborazione del segnale e AI ha effetti marcati sia sul progresso dei veicoli autonomi intelligenti e cognitivi, sia sulla fiducia con cui possiamo garantire la sicurezza di guidatori, passeggeri e pedoni. Tuttavia, tutto diventa irrilevante in assenza di dati dai sensori altamente affidabili, accurati, di alta precisione, assolutamente fondamentali per i veicoli a guida autonoma sicuri.

Esattamente come accade con qualsiasi tecnologia avanzata, più si lavora su questo tema, maggiore è il numero dei casi d’uso complessi che vengono identificati e che richiedono una soluzione. Questa complessità continuerà a destabilizzare la tecnologia attuale per cui, per affrontare a viso aperto questi problemi, dovremo attendere la prossima generazione di sensori e di algoritmi di sensor fusion.

Tuttavia, come spesso accade quando si parla di grandi innovazioni, l’aspirazione e l’intraprendenza umana verso i veicoli autonomi avrà un impatto positivo, rivoluzionario e di lunga durata sulla società. Il passaggio dalla guida assistita alla guida autonoma non solo migliorerà in modo drastico la sicurezza dei trasporti, ma porterà anche enormi aumenti della produttività. Questo futuro dipende da una base solida di sensori ad alta integrità.

Analog Devices si occupa di sicurezza Automotive e di ADAS da 25 anni. Oggi, ADI sta spianando il terreno per un futuro autonomo. Coordinato con centri di eccellenza nella navigazione inerziale e nel monitoraggio e nei sistemi radar & lidar ad alte prestazioni, il gruppo di lavoro per il trasporto autonomo di Analog Devices offre soluzioni per sensori, catene del segnale e alimentazione ad alte prestazioni, destinate a migliorare drasticamente capacità e prestazioni di questi sistemi, accelerando il nostro viaggio verso il futuro.

A cura di Chris Jacobs

Vice President, Autonomous Transportation and Safety, Analog Devices, Inc.