Integrare un assistente vocale in un dispositivo indossabile è una delle applicazioni più affascinanti del mondo maker. Utilizzando un Raspberry Pi, un microfono, uno speaker e la potenza dell’Intelligenza Artificiale di ChatGPT, è possibile costruire un vero e proprio assistente virtuale da polso. Il progetto consente di combinare tecnologia open source, portabilità e funzionalità avanzate, creando un dispositivo unico, altamente personalizzabile e indipendente dai grandi ecosistemi commerciali.

Introduzione

Nel panorama della tecnologia indossabile, l’unione tra Intelligenza Artificiale e dispositivi fai-da-te apre la strada a progetti innovativi, accessibili e profondamente personalizzabili. Tra questi, la realizzazione di un assistente vocale da polso rappresenta una sfida entusiasmante per chi desidera combinare programmazione, elettronica e design. Utilizzando un Raspberry Pi, è possibile costruire un vero e proprio wearable smart assistant, capace di comprendere comandi vocali, dialogare con l’utente attraverso la potenza di ChatGPT e persino interfacciarsi con l’ambiente domestico tramite piattaforme come Home Assistant. Tutto ciò all’interno di un contenitore stampato in 3D, compatto e pensato per essere indossato come un moderno smartwatch. L’idea alla base del progetto è semplice: trasformare un mini computer in un assistente virtuale portatile, sempre disponibile, che risponda con la voce, elabori richieste e interagisca con servizi online. Grazie alla connessione Wi-Fi, il dispositivo può accedere alle API di OpenAI e restituire risposte in linguaggio naturale, sfruttando microfono e speaker per la comunicazione audio.

Non si tratta solo di tecnologia: il fattore ergonomico è fondamentale per l’utilizzo quotidiano. Per questo, il design del case deve garantire leggerezza, accessibilità alle porte e un’estetica discreta ma funzionale. In questo articolo ti guideremo attraverso tutte le fasi del progetto: dalla scelta dei componenti hardware alla configurazione del software, fino alla stampa del case. Viene inoltre presentato uno script Python che integra il riconoscimento vocale, le API di ChatGPT e la sintesi vocale, accompagnato da spiegazioni dettagliate per facilitare l’apprendimento anche a chi si avvicina per la prima volta al mondo della programmazione embedded. Insomma, una guida completa per costruire un wearable intelligente con riconoscimento vocale, API AI e case stampato in 3D. L’obiettivo è creare un assistente personale intelligente, libero dai vincoli delle grandi piattaforme commerciali e perfettamente adattabile alle proprie esigenze.

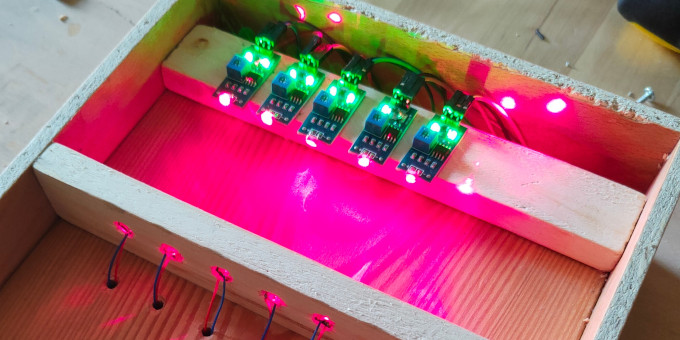

Componenti hardware per un assistente vocale indossabile

La scelta dell’hardware è il primo passo. Raspberry Pi Zero W rappresenta la soluzione ideale per chi desidera un dispositivo compatto, mentre Raspberry Pi 4 offre una potenza di calcolo maggiore, utile per elaborazioni vocali più complesse. A supporto, serve una batteria portatile ricaricabile in grado di alimentare il sistema per almeno 2-3 ore, mantenendo al tempo stesso un peso contenuto per l’uso al polso. Un microfono USB o I2S è indispensabile per acquisire la voce dell’utente con precisione. Per l’output vocale, si può utilizzare uno speaker miniaturizzato collegato all’uscita audio del Raspberry o tramite un DAC I2S. Una connessione WiFi stabile è essenziale per comunicare con le API online, come ChatGPT, mentre il Bluetooth può servire per controlli esterni o auricolari wireless.

Configurazione dell’assistente vocale sul Raspberry Pi

Dopo aver installato Raspberry Pi OS, si procede con la configurazione dell’ambiente vocale. La combinazione di riconoscimento vocale, Intelligenza Artificiale e sintesi vocale permette di creare un flusso naturale: ascolto dell’utente, elaborazione della richiesta, risposta audio. È necessario installare alcuni pacchetti Python per registrare l’audio, interpretarlo, inviarlo all’Intelligenza Artificiale di OpenAI e poi riprodurne la risposta. Il codice seguente mostra uno script basilare che può già fornire un’esperienza funzionale.

Script Python per assistente vocale: spiegazione e funzionamento

Per avviare il sistema, si installano le librerie necessarie:

sudo apt update sudo apt install python3-pyaudio espeak ffmpeg -y pip3 install openai speechrecognition pyttsx3

Lo script si suddivide in tre parti principali: ascolto della voce, invio della richiesta all’API di ChatGPT e riproduzione della risposta.

Di seguito il codice completo:

import openai

import speech_recognition as sr

import pyttsx3

import os

# Chiave API per accedere a ChatGPT

openai.api_key = "INSERISCI_LA_TUA_API_KEY"

# Inizializzazione del motore di riconoscimento vocale e sintesi vocale

recognizer = sr.Recognizer()

tts = pyttsx3.init()

tts.setProperty('rate', 150) # Velocità della voce

# Funzione per riprodurre una risposta vocale

def speak(text):

print("Assistente:", text)

tts.say(text)

tts.runAndWait()

# Funzione per inviare una richiesta a ChatGPT e ottenere la risposta

def ask_chatgpt(prompt):

response = openai.ChatCompletion.create(

model="gpt-3.5-turbo",

messages=[{"role": "user", "content": prompt}]

)

return response.choices[0].message['content'].strip()

# Funzione per ascoltare l'utente tramite microfono

def listen():

with sr.Microphone() as source:

print("Parla ora...")

audio = recognizer.listen(source)

try:

text = recognizer.recognize_google(audio, language="it-IT")

print("Hai detto:", text)

return text

except sr.UnknownValueError:

return "Non ho capito, riprova."

except sr.RequestError:

return "Errore di connessione."

# Ciclo principale del programma

while True:

input_text = listen()

if input_text.lower() in ["esci", "stop", "termina"]:

speak("Arrivederci!")

break

response = ask_chatgpt(input_text)

speak(response)

Procediamo ora con la spiegazione del funzionamento. Il programma ascolta l’utente usando il microfono e converte l’audio in testo grazie alla libreria speech_recognition. La frase ottenuta viene inviata al modello di linguaggio ChatGPT tramite API, che restituisce una risposta. Infine, il testo viene letto ad alta voce tramite pyttsx3, un motore di sintesi vocale compatibile con Linux. Un semplice ciclo while mantiene attivo l’assistente fino a quando l’utente pronuncia un comando per uscire, come "stop" o "esci".

Integrazione con sistemi domotici tramite Home Assistant

L’assistente non è limitato a conversazioni. Integrare Home Assistant permette di controllare dispositivi smart tramite comandi vocali. Attraverso webhook, MQTT o REST API, l’assistente può accendere luci, controllare elettrodomestici o leggere sensori ambientali. Nel codice, basta aggiungere una sezione che riconosce parole chiave come "accendi la luce" o "imposta la temperatura" e invia il comando al server Home Assistant. Ogni comando vocale può quindi diventare un’azione reale nell’ambiente domestico.

Design ergonomico e stampa del case da polso

Il fattore di forma è fondamentale per un dispositivo indossabile. Un case stampato in 3D deve ospitare tutti i componenti senza risultare troppo ingombrante. Le dimensioni ideali si aggirano intorno ai 60 x 40 x 20 mm. È importante garantire un buon flusso d’aria per la dissipazione del calore e assicurare aperture per USB, microfono, speaker e, se presente, un piccolo display OLED o touchscreen. Il cinturino può essere integrato nel design o ricavato da un vecchio smartwatch. Il materiale più adatto è il PLA, facile da stampare e abbastanza resistente, oppure PETG se serve maggiore flessibilità. Se si prevede l’uso in esterno, meglio optare per materiali che resistono a caldo, urti e umidità. Un display opzionale da 0.96" può fornire feedback visivo come notifiche, batteria o trascrizione del testo parlato.

Sicurezza, prestazioni e aggiornamenti

Ogni assistente intelligente deve gestire le comunicazioni in modo sicuro. Usare solo connessioni HTTPS per le API e nascondere la chiave di accesso OpenAI con variabili d’ambiente sono misure minime. È buona norma inoltre disabilitare SSH quando non necessario, oppure proteggerlo con una chiave privata. Per gestire gli aggiornamenti del software, si può usare Git o uno script che controlla regolarmente la presenza di nuove versioni del codice. Un’organizzazione modulare del software facilita l’aggiunta di nuove funzionalità, come comandi personalizzati, modalità offline o accesso via Bluetooth. Ridurre al minimo i processi attivi quando il sistema è in standby consente di prolungare la durata della batteria e prevenire surriscaldamenti.

Conclusioni

Costruire un assistente vocale da polso con Raspberry Pi e ChatGPT è un progetto che unisce Intelligenza Artificiale, design open source e hardware accessibile. Ogni elemento può essere personalizzato, dal codice all’involucro, offrendo un’esperienza su misura. Si ottiene così un dispositivo versatile, capace di rispondere a domande, controllare la casa e accompagnare l’utente nelle attività quotidiane. Chi vuole spingersi oltre può aggiungere sensori biometrici, GPS, feedback aptico o funzionalità cloud. Si tratta di un perfetto esempio di come la tecnologia indossabile possa evolvere in modo creativo, funzionale e totalmente personalizzato.