La tecnologia offre diversi modi di interazione, per i computer siamo quasi sempre rimasti con i metodi classici ovvero mouse e tastiera, passando con altre alternative come il riconoscimento vocale e touch screen che si stanno diffondendo sempre di più. Il tatto e la vista sono elementi naturali che utilizziamo per interagire con il mondo circostante, e l’interazione tra uomo e computer/tecnologia si affiderà proprio a questi sensi per risolvere alcune delle sfide più complicate. Stiamo per giungere all’era dei sistemi cognitivi in grado di apprendere, percepire, interpretare ed interagire con l’ambiente circostante. Nel prossimo futuro i nostri computer avranno la possibilità di imitare i sensi umani, quali l’olfatto e il tatto, con la possibilità di ragionare in relazione ad un evento.

Introduzione

Nei prossimi anni ci saranno decisamente nuove rivoluzioni nel campo dell’interazione uomo-macchina; dovremmo essere in grado attraverso lo schermo del dispositivo mobile o portatile di apprezzare e sentire la qualità di un prodotto quale un tessuto o abbigliamento che si vuole comprare. Molti ricercatori stanno studiando, attraverso tecniche avanzate di vibrazioni, alcune applicazioni in grado di simulare la sensazione fisica: un deciso passo verso una completa interazione tra la tecnologia e il mondo naturale. Attualmente, i computer scattano fotografie, fanno video, e in futuro si potrà implementare la possibilità di riconoscere particolari delle immagini: ovvero la possibilità di interpretare una immagine così come si riesce a riconoscere il profilo di un essere umano grazie alle tecniche di imaging. Il settore che ne beneficerà di più è quello medico, grazie alla tecnologia si potrà distinguere gli indizi di una malattia in seguito ad una ecografia o risonanza magnetica. Le macchine contribuiranno insieme ai medici a rilevare con più accuratezza e rapidità eventuali problemi e anomalie presenti nelle varie analisi per far fronte a determinate soluzioni. Quindi, nei prossimi anni i nostri computer saranno in grado di trasformare i singoli pixel in un significato, capirne il senso e interpretare quindi la singola fotografia. I computer del futuro non troppo lontano saranno in grado di vedere le sottigliezze di immagini invisibili all'occhio umano. Per esempio, i computer saranno in grado di distinguere rapidamente un tessuto malato da uno sano su una risonanza magnetica con riferimenti incrociati nella letteratura scientifica al fine di produrre una diagnosi.

L’obiettivo è progettare una piattaforma in grado di imitare il cervello umano, in particolare la sua capacità di poter interagire con l’ambiente circostante tenendo memoria dei fatti accaduti e imparando dagli errori commessi.

Il futuro

Il nostro orecchio percepisce una miriade di suoni e rumori che non sempre ha la capacità di interpretarli. I futuri sensori intelligenti dell’udito saranno in grado di rilevare ogni elemento che caratterizza il suono in relazione a dati scientifici presenti in qualche database, ci permetteranno inoltre di interpretare vari eventi che si distinguono con suoni pre-monitori di bassissima intensità. I computer con i loro sensori uditivi potranno individuare suoni relativamente a vibrazioni e onde sonore a varie frequenze, ed interpretandoli opportunamente potranno prevedere la caduta di alberi o di massi (frane). Il sistema di alert potrà avvertirci di un pericolo imminente così come attualmente lavora un sistema per la predizione dei terremoti. La capacità sarà proprio di prevedere sempre di più il futuro degli eventi, aumentando il tempo a disposizione per mettersi al riparo e prendere provvedimenti opportuni per la messa in sicurezza. Gli Ingegneri della IBM stanno lavorando a vari progetti in grado di interpretare i rumori sottomarini e la possibilità di studiare il moto ondoso con l’impatto sulla vita. Studi che potrebbero rivoluzionare ogni genitore per capire finalmente il linguaggio dei neonati; ovvero, mettere in correlazione i suoni emessi dal bambino con le informazioni fisiologiche quali la frequenza cardiaca e la temperatura. Gli sviluppi sul riconoscimento vocale porteranno a numerosi programmi per comprendere il tono di un nostro interlocutore con la possibilità di analizzare al meglio il comportamento, decidendo quindi di interagire sia da un punto di vista di business (vedi i call center) sia dal punto di vista sociale migliorando le differenze culturali tra le varie popolazioni. Anche il palato ha la sua tecnologia: nel futuro i computer saranno in grado di scomporre a livello molecolare i vari ingredienti per poi elaborare ricette ad hoc, incrociando a sua volta i dati riguardanti i sapori che distinguono gli individui. Le tecnologie del futuro avranno inoltre la possibilità di essere dotati di sensori particolari con la capacità di analizzare gli odori presenti nell’ambiente. In questo modo potremmo sapere ciò che respiriamo e prendere provvedimenti in merito. Il computer sarà un valido supporto per la diagnosi di malattie, come raffreddori o bronchite; rilevando (con opportuni sensori) le particelle presenti nell’aria, i programmi di gestione saranno in grado di prevedere l’insorgenza di virus pericolosi per la nostra salute. Inoltre, ci sarà la possibilità di rilevare il livello d’igiene presente nell’ambiente (soprattutto negli ospedali). Oppure, in aiuto agli agricoltori, la possibilità di stabilire le condizioni di lavoro favorevoli o meno per l’opportuna piantagione (Figura 1), con sensori che monitorano l'attività del suolo.

Figura 1: I sensori MEMS dovrebbero rappresentare un buon successo per l’implementazione dei vari sensi umani

iCub: il robot con intelligenza artificiale

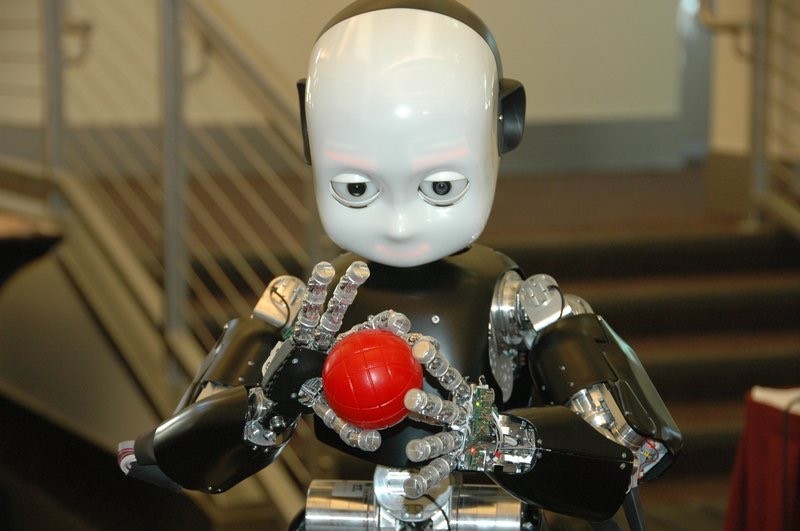

iCub è il famoso robot del progetto EU RobotCub sviluppato qualche tempo fa, che grazie ai sensori interni è in grado di percepire sensazioni tattili con la presenza di un tessuto flessibile collegato a sensori touch: ovvero un sistema in grado di imitare la nostra pelle umana. Il cervello del robot è basato su modelli ispirati alla biologia con sensori di imaging per muoversi nello spazio circostante e simulare il comportamento di un bambino (Figura 2).

Il sistema riesce a riconoscere un certo numero di oggetti in relazione alla posizione relativa e alla forza esercitata per prenderlo. Tutte le informazioni sono analizzate da un processore per poi restituire un feedback di controllo e decisione. Il progetto open source è in continua fase di sviluppo per migliorarne l’elettronica e l’autoapprendimento, la comunità di sviluppatori è cresciuta negli anni fornendo a iCub una serie di nuove abilità.

Intelligenza artificiale, sensori umani, autoapprendimento, sono solo alcuni dei principali temi che vedranno cambiare il nostro modo di comunicare con la tecnologia.

Conclusioni e considerazioni

I computer saranno dotati di sensi umani: vista, udito, gusto, olfatto e tatto, aiutando ad analizzare molte situazioni e porre eventuali rimedi. Ottenendo così una maggiore sicurezza sugli eventi e una migliore interpretazione dell’ambiente circostante. L’intelligenza artificiale potrà diventare l’interprete per i big data del prossimo futuro, studiando per esempio la domanda di energia in real time in accordo ai parametri ambientali e massimizzando nello stesso tempo l’efficienza energetica complessiva. Le numerose interfacce di gesture recognition e la tecnologia virtuale aiuteranno ad interagire con i computer senza contatto fisico, semplificando a sua volta le operazioni di controllo.

5 sensi, interfacce senza contatto fisico, robot…uno sviluppo tecnologico per un deciso cambiamento sociale e non solo. L’intelligenza artificiale potrebbe essere la colonna portante per lo sviluppo di numerose tecnologie finalizzate all’autoapprendimento.

Articolo veramente affascinante. Le nuove tecnologie abbinate all’Intelligenza artificiale sembrano aprire orizzonti inimmaginabili, al limite della fantascienza.

Fra tutte le opportunità di usare i computer,rilevando (con opportuni sensori) le particelle presenti nell’aria, i programmi di gestione saranno in grado di prevedere l’insorgenza di virus pericolosi per la nostra salute. Infatti già da tempo tramite sensori era già possibile trovare gas inquinanti nell’aria come smog e altri, oggi siamo anche afflitti da epidemie, quale miglior sistema se non questo.