Gli strumenti di misura non sono tutti uguali tra loro. Uno dei parametri che li differenzia è la loro precisione che ne determina, ovviamente, anche il costo. Facciamo una panoramica dell'argomento evidenziando gli aspetti più importanti.

Introduzione

Per misurare i parametri elettrici ed elettronici di un circuito o di un componente elettronico si utilizzano gli strumenti di misura (tester, voltmetri, capacimetri, induttanzimetri, amperometri, ohmmetri, ecc). Quando si effettua una misura di un circuito elettrico o elettronico con uno strumento di misura, al momento del suo collegamento si modificano le sue caratteristiche globali in quanto esso costituisce, a tutti gli effetti, un carico con un suo intrinseco assorbimento. E' opportuno scegliere, dunque, una strumentazione opportuna e di alta qualità, se necessitano risultati da essa indipendenti e relativi, il più possibile, al circuito sotto test. La classe di precisione (o classe di accuratezza), pertanto, restituisce l'accuratezza dello strumento. In pratica esso costituisce un parametro riassuntivo di tutte le sue cause di errore. La classe di precisione rappresenta il valore massimo dell’incertezza che si può riscontrare in qualunque punto della scala, espresso in percentuale del valore del fondo scala. Per esempio, un voltmetro con una portata di 200V e una classe di precisione dell'1% presenta un’incertezza massima, in ogni punto della scala, di (1/100)*200=2V.

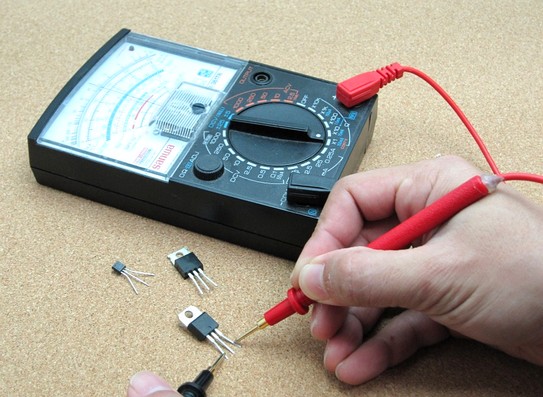

La misura

Le misure di una grandezza non sono mai esenti da errori, e il valore ottenuto non è quello mai esatto ma è, più o meno, approssimato. L'ammontare dell'errore dipende da molti fattori, alcuni dei quali legati all'abilità e alla perizia dell'operatore che effettua la misura ma anche, e soprattutto, alla classe di precisione dello strumento (vedi figura 1).

Classificazione

Secondo le norme CEI vi sono diverse classi di precisione per gli strumenti di misura. Esse indicano il valore dell'errore (in percentuale) fornito dallo strumento relativamente alla misura di fondo scala. Le classi di precisione, allo stato attuale, sono le seguenti:

0.05 - 0.1 - 0.2 – 0.3 - 0.5 – 1 – 1.5 – 2 - 2.5 – 3 - 5

Tali classi impongono dei limiti massimi di errore rispettivamente pari a:

±0.05%, ±0.1%, ±0.2%, ±0.3%, ±0.5%, ±1%, ±1.5%, ±2%, ±2.5%, ±3%, ±5%

Su un voltmetro, ad esempio, con portata massima di 200V caratterizzato da una classe di 0.2, possiamo dire che, misurando una tensione di 200V, essa potrebbe essere affetta da un errore percentuale massimo dello 0.2%. Ciò vuol dire che la misura finale restituita potrebbe essere compresa nell'intervallo 199.6V÷200.4V.

E' possibile ricavare, in senso opposto, anche la classe di precisione dello strumento esaminando la misura ottenuta, con un riferimento molto più preciso. Ad esempio, se si conosce, con certezza, che la corrente che passa da un conduttore ammonta a 5A e il nostro strumento fornisce, invece, una misura di 4.95A, vuol dire che stiamo utilizzando un amperometro appartenente alla classe di precisione 1.

La finalità di utilizzo dello strumento, pertanto, è la prima caratteristica da considerare per la scelta della classe di precisione. A seconda della sua collocazione e del suo impiego per i quali esso sarà utilizzato, possiamo distinguere le seguenti applicazioni:

- Classe 2÷5: si tratta di normali strumenti da quadro elettrico, per i quali non è richiesta una elevatissima precisione di misura come, ad esempio, nei quadri industriali (vedi figura 2);

- Classe 1.5: si riferisce agli strumenti da quadro di precisione e di portatili normali;

- Classe 1: si tratta di strumenti portatili di controllo;

- Classe 0.5: è relativa a strumentazione portatile da laboratorio per la quale è richiesta una buona precisione;

- Classe 0.2÷0.3: si riferisce a strumenti portatili di buona precisione, soprattutto utilizzati per effettuare misure e controlli in laboratorio;

- Classe 0.05÷0.1: caratterizzano gli strumenti da laboratorio di grande precisione.

Determinazione della classe di precisione

La definizione dell'indice di classe su uno strumento è effettuata tramite una taratura, utilizzando un dispositivo campione, molto più preciso e preso come riferimento. La procedura, semplicissima da eseguire, è la seguente:

- Si procuri, ovviamente, uno strumento di misura caratterizzato da un'ottima classe di precisione, molto migliore dello strumento che vogliamo testare;

- Si effettuino tante misure e si raffrontino quello dello strumento campione e di quello in prova. Si calcolino, quindi, gli scostamenti assoluti;

- Si consideri, poi, l'errore massimo della serie, si moltiplichi per 100 e si divida il risultato per la portata di fondo scala. Si arrotondi, eventualmente, per eccesso il valore ottenuto. Esso costituisce la classe di precisione finale.

Un esempio chiarirà, ancora meglio, tale procedura. Si abbia un voltmetro di cui vogliamo conoscere la classe di precisione. Si effettuino otto misurazioni di una tensione, magari in tempi successivi, impostando il fondo scala a 200V, con i due strumenti. Esse danno luogo alla seguente tabella di rilevazioni:

| Misurazione | 1° | 2° | 3° | 4° | 5° | 6° | 7° | 8° |

| Strumento di prova | 198V | 198.2V | 199V | 201.3V | 200.4V | 197.7V | 202.2V | 200.7V |

| Strumento campione | 200V | 200V | 200V | 200V | 200V | 200V | 200V | 200V |

| Scostamenti assoluti | 2 | 1.8 | 1 | 1.3 | 0.4 | 2,3 | 2,2 | 0,7 |

Si osservi la serie degli scostamenti assoluti e si consideri il valore di errore maggiore, ossia quello relativo a una differenza di 2.3 (sesta misurazione). Si esegua, quindi, la seguente formula:

classe di precisione = εAMax * 100 / Portata di Fondo Scala

da cui:

classe di precisione = 2.3 * 100 / 200

Lo strumento in questione è caratterizzato, dunque, da una classe di precisione (arrotondata) pari a 1.5. Grazie alla classe di precisione di uno strumento è molto facile calcolare l’errore assoluto massimo di cui può essere contraddistinta ciascuna misurazione, effettuata con uno specifico strumento.

Si osservi che l'incertezza ha lo stesso effetto in ogni punto del campo di misura, causando errori relativi importanti, specialmente nella parte iniziale della scala. Pertanto, è buona norma effettuare le misure il più possibile verso il fondo scala, al fine di minimizzare gli errori.

Quanto detto fino a ora vale, in massima parte, per gli strumenti analogici. Per gli strumenti digitali, invece, la componente dell’incertezza legata al fondo scala viene espressa in termini di numero di cifre, o digits. Per esempio, esaminando uno strumento con 3 ½ cifre, supponiamo che esso possa rappresentare al massimo il valore 2999. Se questo strumento ha una componente d'incertezza di 4 digit, l’errore, dato in percentuale del fondo scala, sarà pari a 100*(4/3000) = 0,13%.

Errore assoluto ed errore relativo

Il massimo errore assoluto che lo strumento può commettere è l'errore (in più o in meno) calcolato sul valore massimo del fondo scala della misura. Ad esempio, per un apparecchio di classe di precisione di 2 e un fondo scala pari a 200V, il massimo valore dell'errore assoluto ammonta a 4V. In tutti i punti di misura sulla scala fino a 200V, l'errore massimo riscontrabile sarà pari a 4V (in più o in meno). Fondamentalmente è meglio commettere tale errore nella parte finale della scala, verso il fondo scala, che nella parte iniziale. Se si riscontra un errore assoluto di 4V misurando una tensione di 10V si avrà un errore relativo del (4*100)/10=40% mentre misurando una tensione di 180V con lo stesso errore assoluto produrrà un errore relativo del (4*100)/180=2,22% come, appunto, puntualizzato in precedenza.

Quando acquistiamo uno strumento di misura, magari economico, abbiamo qualche parametro in più per valutare la sua bontà.